L’assistente vocale 'troppo umano' di Google non è piaciuto a tutti. Ed è una questione di etica

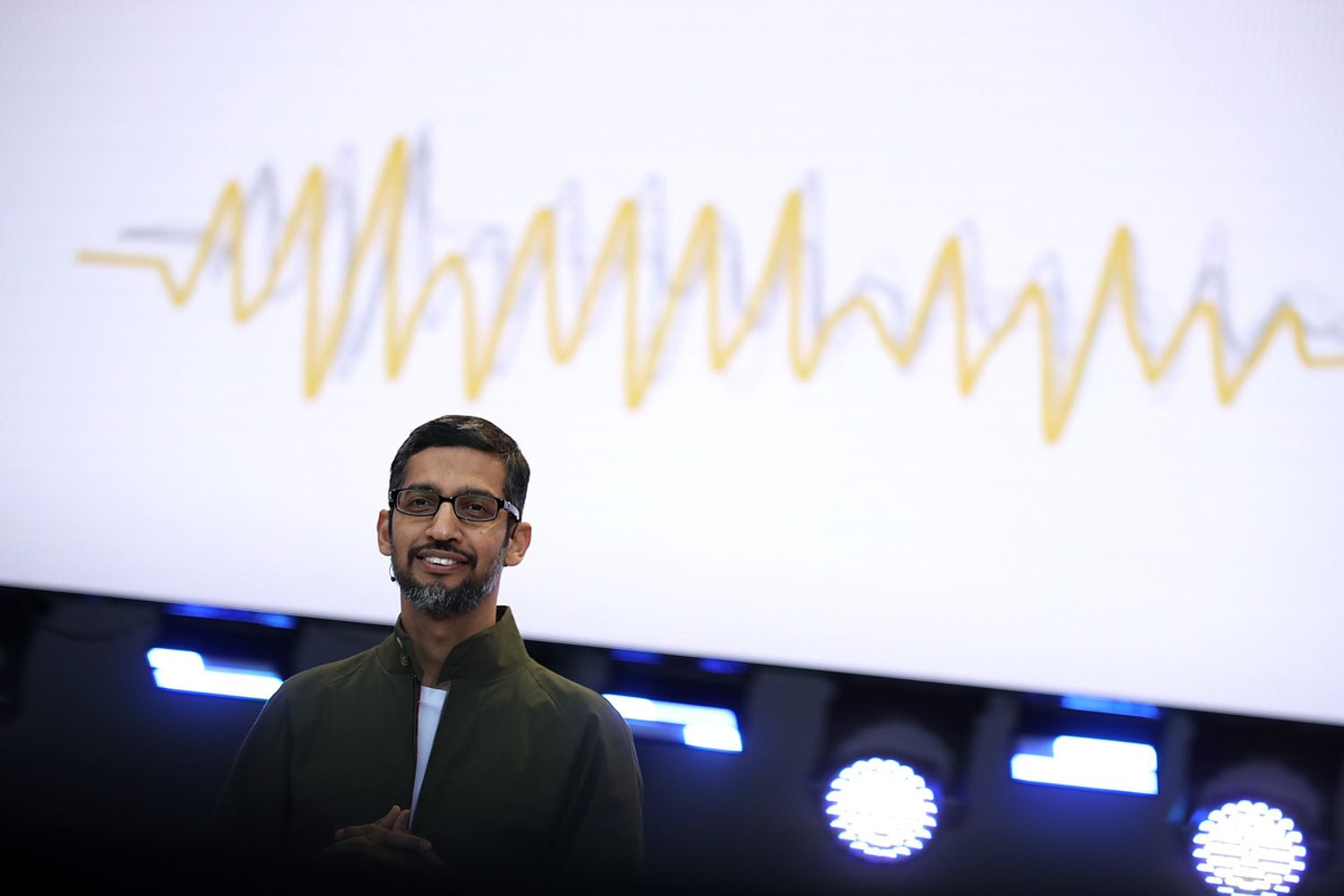

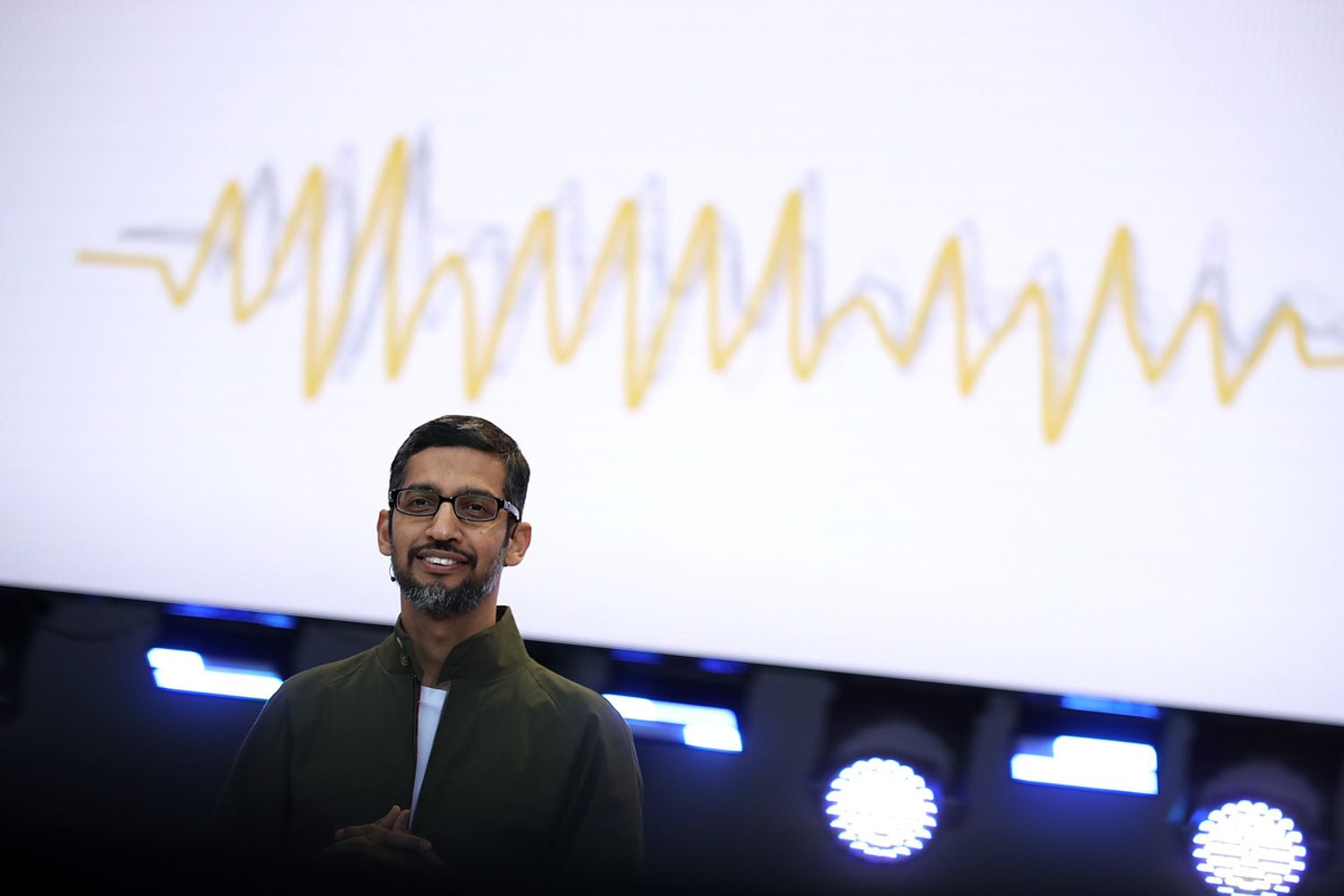

- Sundar Pichai alla presentazione di Duplex, il nuovo assistente vocale di Google

La platea era apparsa entusiasta. Quando il Ceo di Google, Sundar Pichai, aveva fatto ascoltare delle telefonate in cui un software basato su intelligenza artificiale parlava in modo naturale con un essere umano, inframmezzando pure delle pause e interiezioni (inclusi suoni come “aaah” ,“mmm”), il pubblico era scoppiato in un applauso e in risate complici. Doveva essere uno di quei momenti magici che piacciono tanto in Silicon Valley.

“Mette assieme tutti i nostri investimenti fatti negli anni sulla comprensione del linguaggio naturale, la trasformazione del testo in parlato e il deep learning (una branca del machine learning, e dunque dell’intelligenza artificiale, ndr)”, aveva commentato Pichai.

Ma nel giro di poche ore le reazioni al di fuori della mura ovattate del summit di Google sono state di tutt’altro tenore. Prima di arrivare alla polemica, ricordiamo brevemente ci cosa si sta parlando.

Durante Google I/O, la conferenza del colosso tech dedicata agli sviluppatori, il Ceo Sundar Pichai ha fatto ascoltare le registrazioni di due telefonate, la prima per prenotare un tavolo a un ristorante, la seconda per fissare un taglio di capelli dal parrucchiere. In entrambi i casi a parlare per conto del cliente era Duplex, una funzione di Google Assistant, l’assistente vocale dell’azienda tech, che riusciva a interagire con gli esseri umani dall’altra parte della cornetta in modo naturale e sembrando a sua volta umano.

La voce appare quella di una persona, non suona robotica; in più usa pause e intercalari umani per rendere l’esperienza della conversazione più naturale. A parte per alcune risposte che suonano un po’ formali nella composizione della frase, nel complesso la performance mostrata si mimetizza bene come umana, specie nella breve e limitata interazione necessaria a prenotare un tavolo o una seduta dal parrucchiere.

Tuttavia la dimostrazione fatta da Google- attraverso chiamate preregistrate, non erano in diretta - non ha dato alcuna indicazione del fatto che dall’altra parte l’essere umano in carne e ossa che interagiva con Duplex fosse stato avvisato. Qui sotto si possono ascoltare le chiamate

E dunque in poco tempo sono iniziate ad arrivare le critiche da parte di molti osservatori, secondo i quali Google avrebbe sviluppato una tecnologia in grado di ingannare gli interlocutori fingendosi umana.

“Orripilante”, l’ha definita su Twitter senza mezzi termini Zeynep Tufekci, professoressa alla University of North Carolina, nota e autorevole studiosa dell’impatto delle tecnologie sulla società, e voce critica dei colossi tech.

“Google Assistant che fa telefonate fingendo di essere umano e non dicendo di essere un bot, aggiungendo “ummmm” e “aaaah” per ingannare l’umano dall’altra parte con la platea che applaude...orripilante. La Silicon Valley è eticamente persa, alla deriva e non ha imparato nulla”.

Google Assistant making calls pretending to be human not only without disclosing that it's a bot, but adding "ummm" and "aaah" to deceive the human on the other end with the room cheering it... horrifying. Silicon Valley is ethically lost, rudderless and has not learned a thing.

— zeynep tufekci (@zeynep) May 9, 2018

Quella di Tufekci non è stata l’unica voce critica, anche se forse la più eclatante. Così, ieri Google è corsa ai ripari facendo sapere che aggiungerà nuove funzioni alla sua tecnologia Duplex - che per ora permette a un software basato su intelligenza artificiale di fare telefonate per prenotare appuntamenti - in modo da rivelare agli interlocutori la sua identità di robot. "Comprendiamo e diamo importanza alla discussione sviluppatasi attorno a Google Duplex”, ha dichiarato l’azienda in una nota. “Come abbiamo detto fin dall’inizio, la trasparenza nella tecnologia è importante. Stiamo progettando questa funzione con meccanismi di trasparenza incorporati, e faremo in modo che il sistema sia identificato in modo appropriato. Quello che abbiamo mostrato a I/O era una prima demo, e vogliamo aggiungere dei feedback mano a mano che la sviluppiamo”.

Ma al di là della pezza, il dibattito fra gli addetti ai lavori era decollato. “Gli esperimenti di Google sembrano progettati per ingannare”, ha commentato su TechCrunch Thomas King, ricercatore del Digital Ethics Las dell’Oxford Internet Institute. “All’università se provi a fare qualcosa che coinvolge l’idea di ingannare qualcuno devi dimostrare che ci sia davvero un valore scientifico in quello che stai facendo”.

“Questa tecnologia è meravigliosa e un grande passo in avanti, ma non credo che lo scopo principale di una AI (Artificial Intelligence) sia di imitare gli umani”; ha commentato sul Washington Post il professore del MIT Erik Brynjolfsson. “Invece i ricercatori dovrebbero rendere più semplice per gli umani capire se stanno interagendo con una persona o con una macchina”.

La stessa Zeynep è tornata sul tema specificando in altri tweet che “mentre le tecnologie digitali diventano più capaci a fare azioni umane, l’attenzione deve essere su come proteggere le persone, come distinguere umani e macchine, e come creare segnali affidabili per ognuna. Vedete il 2016. Questo invece è un inganno diretto e deliberato. Non va bene”. Il riferimento è alle precedenti preoccupazioni sull’uso di social media e piattaforme digitali da parte di bot per diffondere propaganda e disinformazione o altri scopi malevoli, e agli effetti che possono avere sia a livello individuale, sia a livello collettivo.

La discussione si inserisce anche nel più ampio, complesso dibattito su come sviluppare applicazioni di intelligenza artificiale che siano “etiche”, che non rinforzino pregiudizi e non siano discriminatorie, che rispettino la privacy delle persone, che non siano “scatole nere” ma semmai il più possibile trasparenti rispetto ai propri “meccanismi decisionali”.