Gli stimoli elettrici che ci consentiranno di parlare con la mente

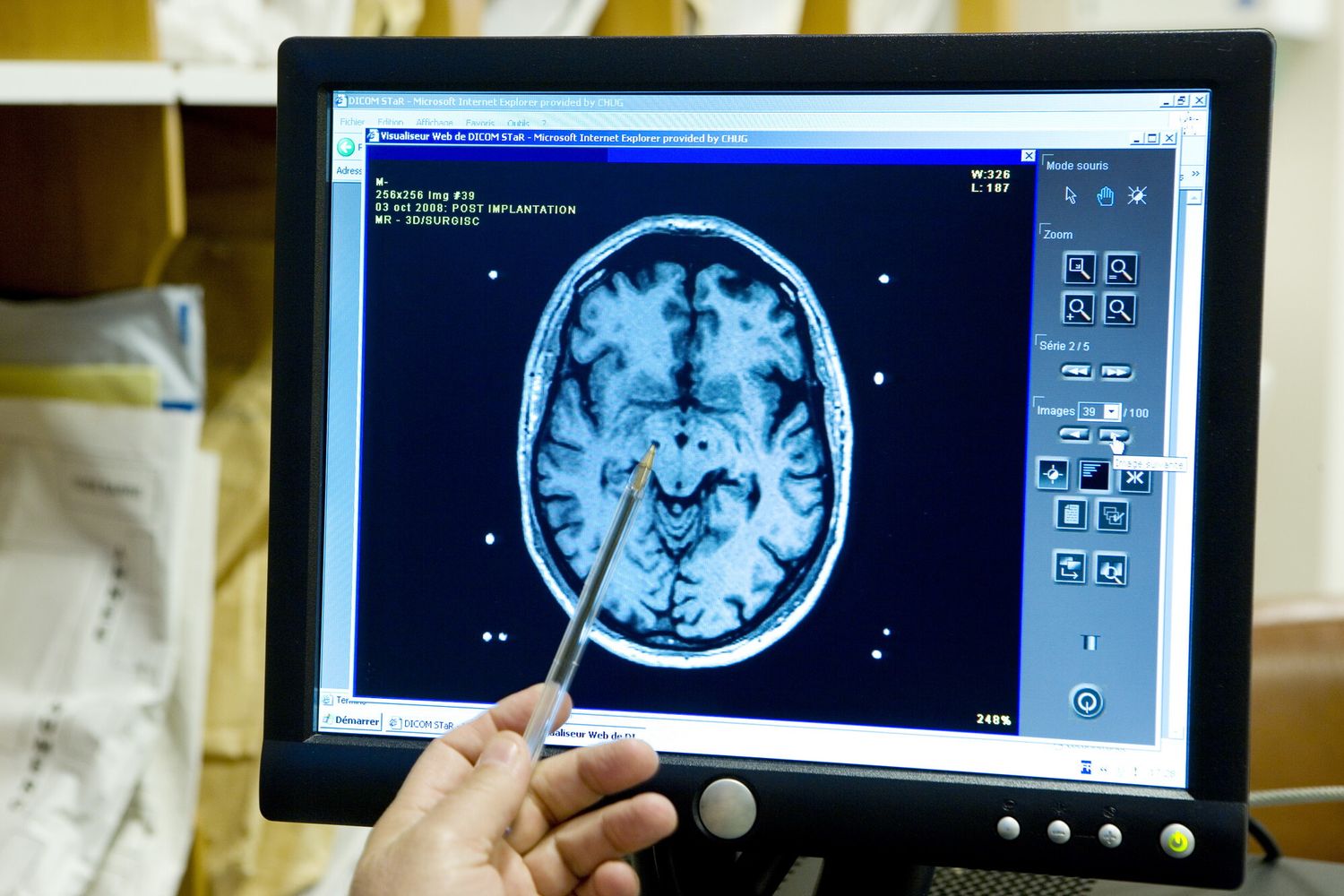

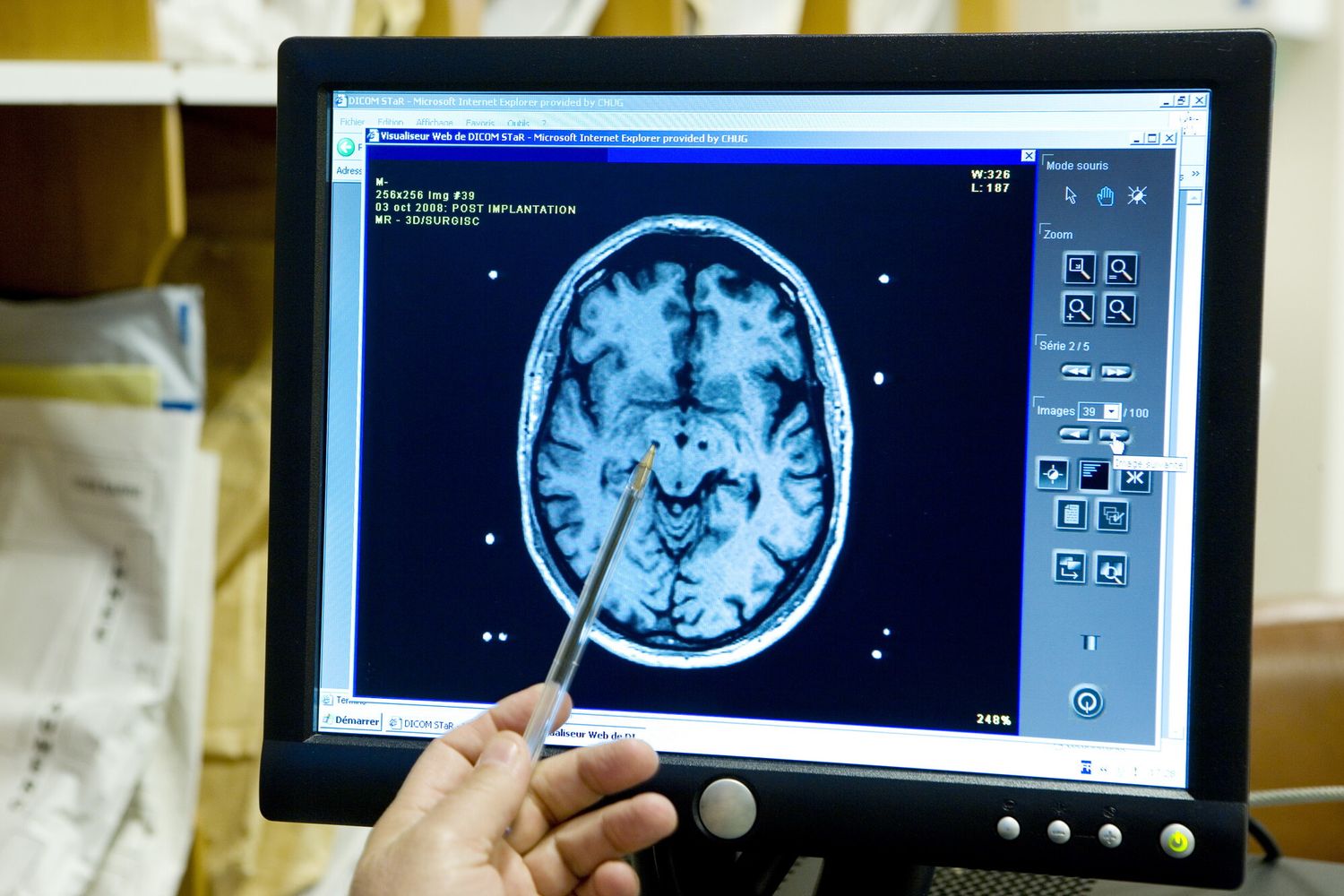

- Una radiografia di un cervello

In origine fu il grande neurochirurgo Wilder Penfield, il creatore del primo centro al mondo di neuroscienze (il Montreal Neurological Institute), a capire che il segreto per decodificare il linguaggio della nostra mente era l’elettricità.

Durante i suoi interventi per rimuovere i focolai epilettogeni, Penfield mappava con un elettrodo le funzioni delle aree attigue alla zona lesionata. In questo modo scoprì l’omuncolo motorio, una porzione di cervello i cui neuroni servono per controllare ogni singola zona del nostro corpo.

Penfield a quei tempi, però, più che stimolare con una piccola scarica elettrica sulla superfice cerebrale non poteva fare. Il suo sogno sarebbe stato la possibilità di avere un registratore che gli potesse dire in diretta cosa stava avvenendo all’interno del cervello senza dover aprire la scatola cranica.

Quella opportunità arrivò negli anni ’70 grazie a José Manuel Rodríguez Delgado, un neurofisiologo spagnolo che brevettò lo stimoceiver, un registratore e stimolatore intracranico impiantato all’interno dei nuclei profondi del cervello, controllato da remoto con delle semplici onde radio, come quelle usate per guidare le macchinine telecomandate. Ovviamente l’apparecchiatura non fu mai provata sull’uomo, ma grazie allo stimoceiver, Delgado riusciva a influenzare i comportamenti degli animali. Il suo esperimento più famoso fu quello in cui riusciva a bloccare a distanza un toro durante una corrida prima che colpisse il torero.

Ma il passaggio all’essere umano avvenne poco dopo, alla fine degli anni ’80, quando si entrò nell’epoca della Deep Brain Stimulation. Finalmente, questo tipo di tecnologia era pronta per poter essere usata sull’uomo. Dopo decine di anni in cui la corrente veniva vista solo come mezzo di stimolazione per scoprire la presenza di anomalie a livello cerebrale, ora poteva essere usata anche per motivi terapeutici. Da quando fu introdotta da Alim Louis Benabid nel 1987, questa tecnologia oggi è particolarmente usata nel curare i disordini del movimento.

Avete mai ascoltato come le popolazioni neurali si parlano fra di loro? Sembra una guerra, in cui diversi schieramenti di mitragliatrici si combattono a suon di scariche “elettriche”. Studiare l’elettricità cerebrale non significa solo inserire un elettrodo per influenzarne l’andamento, ma prima di tutto è necessario capire il linguaggio dei neuroni. L’elettroencefalogramma (EEG) è stato il primo sistema di analisi di imaging in vivo che permette di rilevare il tipo di attività elettrica presente sulla superficie della corteccia. Grazie a questo prezioso strumento possiamo eseguire numerose analisi sull’attività elettrica sia sul sano che sul paziente neurologico in maniera non-invasiva.

Ma l’EEG è stato anche lo strumento alla base dello sviluppo di una nuova corrente: Il Brain Computer Interface (BCI). BCI, significa la possibilità di parlare con un computer non tramite i movimenti sulla tastiera, ma solo attraverso il mio pensiero che viene letto dai tracciati EEG. Una branca che agli inizi degli anni ’90 sembrava pura fantascienza ma che ora ha raggiunto livello eccellenti di applicazione soprattutto su pazienti con disabilità motorie, che hanno perso l’uso di un arto ma non l’attività cerebrale.

Il BCI lavora proprio sul concetto di pensiero: se il corpo non funziona più, può farlo la mente. L’immagine classica del BCI è il computer a cui era collegato il grande fisico Stephen Hawking. All’inizio si trattava di un sintetizzatore vocale in grado di interpretare i segnali periferici diretti alla bocca per l’emissione delle parole e di tramutarli in un linguaggio elettronico grazie ad un database linguistico computerizzato. Nelle versioni più aggiornate il sintetizzatore vocale era stato migliorato con l’introduzione degli algoritmi di intelligenza artificiale, che avevano appreso a riconoscere le diverse intensità di movimento dei muscoli della guancia a cui era collegato un sensore a infrarossi.

Ma per chi ha un deficit neurologico come quello del grande fisico ora siamo davanti a un cambiamento rivoluzionario, che mette insieme tutte le conoscenze della DBS, BCI con gli algoritmi di intelligenza artificiale. Dopo Wilder Penfield, la speranza di far tornare a comunicare tutte le persone che hanno perso l’uso della parola, passa attraverso le scoperte di un altro neurochirurgo esperto di Epilessia: Edward Chang.

In un interessante lavoro pubblicato sulla prestigiosa rivista Nature, il gruppo di ricercatori dell’università di San Francisco ha messo in campo il meglio della neurochirurgia computazionale con la bioingegneria informatica per realizzare un sistema capace di leggere il pensiero legato all’emissione di parole, per poi tradurlo in un messaggio vocale elettronico emesso da un sintetizzatore.

I precedenti modelli di BCI applicati su pazienti neurologici arrivavano a riconoscere e riprodurre elettronicamente 10 parole al minuto. Sappiamo bene, però, che l’essere umano durante una normale conversazione produce oltre 150 parole al minuto. Quindi, per aiutare questi pazienti a tornare a una vita normale si è passati da registrare dati periferici (es. movimento degli occhi, laringe), a registrare direttamente l’attività dell’area cerebrale che controlla i movimenti dei muscoli di laringe, lingua e bocca.

Per farlo sono stati utilizzati 5 pazienti con Epilessia che a causa della loro patologia dovevano essere trattati neurochirurgicamente. Durante l’operazione è stato chiesto loro di pronunciare oltre 100 frasi di senso compiuto durante le quali veniva registrata l’attività elettrica della loro corteccia motoria. L’analisi combinata dei dati neurali e di quelli linguistici veniva effettuata da algoritmi di intelligenza artificiale, capaci di lavorare su migliaia di dati al secondo. In questo modo è stato possibile costruire, per la prima volta, un database neuro-elettrico dell’attività necessaria per pronunciare frasi del tipo: “Gregory e Tom hanno scelto di guardare i cartoni nel pomeriggio”.

Adesso possiamo finalmente sapere come il linguaggio neurale codifica quello verbale. Infatti, alla fine del processo, il software era in grado di riconoscere le frasi, semplicemente analizzando l’attività elettrica cerebrale. La BCI sta per entrare in nuova era in cui la disabilità motoria sarà superata dall’analisi in vivo dell’attività elettrica cerebrale. Con il solo pensiero della mente potremmo comunicare con chiunque.