A che serve un computer quantistico

All’inizio degli anni ‘80, il grande fisico e Premio Nobel Richard Feynman predisse che un computer quantistico sarebbe stato uno strumento efficace per risolvere sofisticati problemi di fisica e di chimica, dato che simulare grandi sistemi quantistici con computer classici avrebbe avuto costi davvero esponenziali. La realizzazione della visione di Feynman pone notevoli sfide sperimentali e teoriche.

Innanzitutto, domandiamoci se un sistema quantistico possa essere progettato per eseguire un calcolo in uno “spazio computazionale” abbastanza grande e con un tasso di errore abbastanza piccolo, tali da fornire una “velocità quantistica” adeguata. In secondo luogo, è possibile formulare un problema difficile per un computer classico, ma facile per un computer quantistico?

La ricerca, pubblicata su Nature, descrive la modalità con la quale il nuovo processore superconduttore utilizzato, che si basa sulla elaborazione dei “qubit” (quantum bit), ha affrontato entrambe le questioni di riferimento. L’esperimento, andato a buon fine, raggiunge la cosiddetta “supremazia quantistica”, una pietra miliare sulla strada del calcolo quantistico su larga scala.

Nel tagliare questo traguardo, viene mostrato che la cosiddetta “accelerazione quantistica” è realizzabile in un sistema appartenente al mondo reale e non è preclusa da alcuna legge fisica nascosta. La supremazia quantistica preannuncia anche l’era delle tecnologie quantistiche su scala intermedia.

L’esperimento di riferimento mostrato ha un’applicazione immediata nella generazione di numeri casuali certificabili. Altri usi iniziali di questa nuova capacità computazionale possono includere i processi di ottimizzazione, l’apprendimento automatico, la scienza dei materiali e la chimica. Tuttavia, realizzare la piena promessa del calcolo quantistico richiede ancora grandi sforzi tecnologici per progettare qubit logici a tolleranza d’errore.

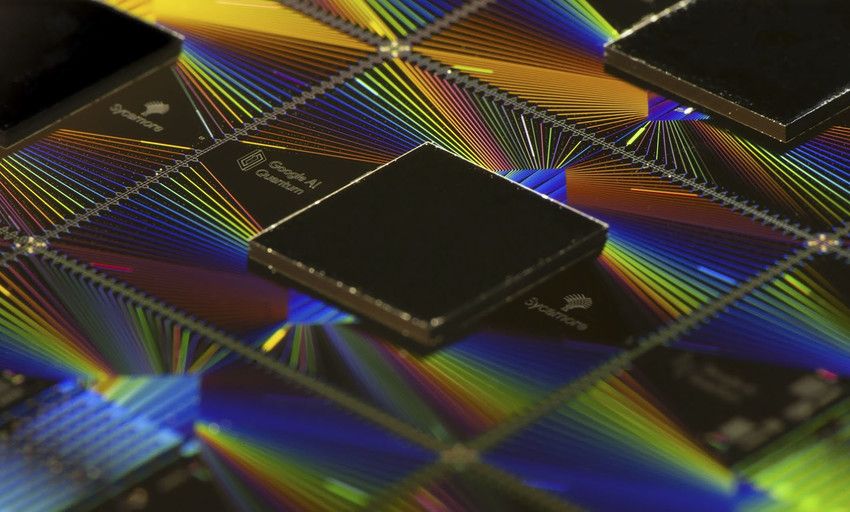

Per raggiungere tale supremazia quantistica, è stato necessario effettuare una serie di progressi tecnici che hanno anche aperto la strada alla correzione degli errori. Sono state sviluppate porte veloci e ad alta fedeltà che possono essere eseguite simultaneamente su un “array qubit bidimensionale”. Il processore è stato calibrato e confrontato sia a livello di componente che di sistema utilizzando un nuovo potente strumento chiamato “benchmarking entropia incrociata”. Infine, sono state sfruttate le fedeltà a livello di componente per prevedere con precisione le prestazioni dell’intero sistema, dimostrando ulteriormente che le informazioni quantistiche si comportano come previsto durante il ridimensionamento a sistemi di grandi dimensioni (scalabilità).

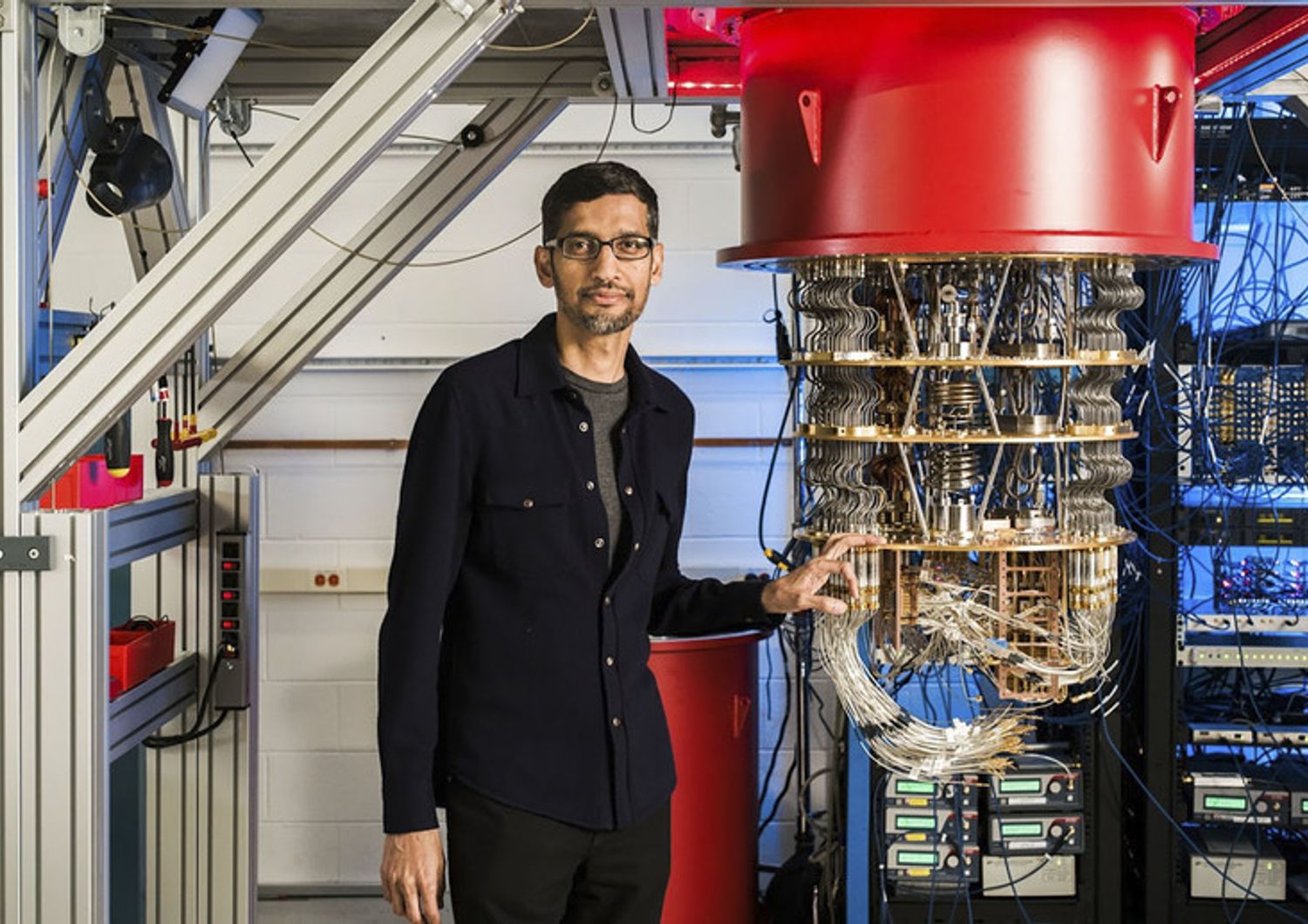

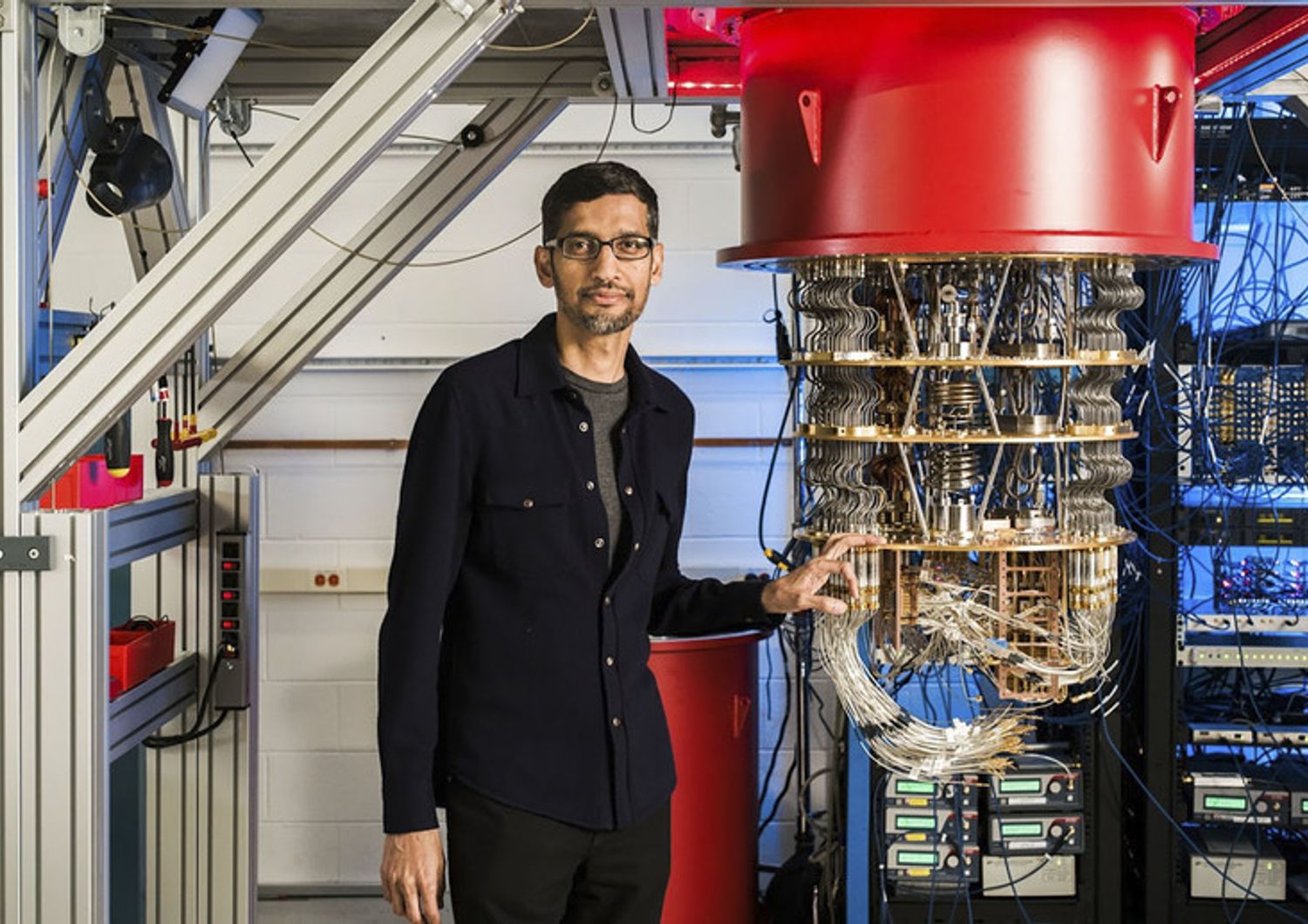

Pertanto, per rivendicare la supremazia quantistica, c’è necessità di un processore quantistico che esegua il programma con tassi di errore sufficientemente bassi. Il processore in oggetto, dotato di queste caratteristiche, è stato chiamato “Sycamore”, che consiste in un array bidimensionale di 54 qubit, ognuno dei quali accoppiato ai quattro più vicini in un reticolo rettangolare. In un circuito superconduttore, gli elettroni di conduzione si condensano in uno stato quantico macroscopico, in modo tale che le correnti e le tensioni si comportino “meccanicamente” in modo quantistico.

I processori quantistici basati su qubit superconduttori ora possono eseguire calcoli in uno spazio (detto di Hilbert) di dimensioni pari a 253 ≈ 9 × 1015, oltre la portata dei supercomputer classici più veloci oggi disponibili. Per quanto sia acquisito a livello di conoscenza, questo esperimento segna il primo calcolo che possa essere eseguito solo su un processore quantistico. È possibile prevedere che la loro potenza computazionale continuerà a crescere a una doppia velocità esponenziale: il costo classico della simulazione di un circuito quantistico aumenta esponenzialmente con il volume computazionale e i miglioramenti dell’hardware probabilmente seguiranno l’equivalente di un processore quantistico (legge di Moore), raddoppiando questo volume computazionale ogni pochi anni. Per sostenere il tasso di crescita e offrire infine il volume computazionale necessario per eseguire algoritmi quantistici ben noti, l’ingegneria della correzione dell’errore quantistico dovrà essere al centro dell’attenzione.

La tesi estesa di Church-Turing afferma che qualsiasi modello di calcolo "ragionevole" possa essere efficacemente simulato da una macchina di Turing. L’esperimento suggerisce che ora potrebbe essere disponibile un modello di calcolo che viola questa affermazione.

E’ stato eseguito un campionamento casuale del circuito quantistico utilizzando un processore quantico realizzabile fisicamente (con tassi di errore sufficientemente bassi), ma non è noto alcun metodo efficiente per i macchinari di calcolo classici. Come risultato di questi sviluppi, il calcolo quantistico sta passando da un argomento di ricerca a una tecnologia che si apre a nuove capacità computazionali. Ma si è a un solo algoritmo creativo, ancora lontano da applicazioni più sofisticate a breve termine.